Ein sogenannter Serverfehler bedeutet, dass der Googlebot eine Unterseite – oder sogar die komplette Seite – nicht abrufen konnte und für eine Abfrage innerhalb eines festgelegten Zeitlimits keine Rückmeldung erhalten hat oder der Zugriff auf die gewünschte URL wurde verweigert. Somit wird der Googlebot genötigt, die Anfrage abzubrechen.

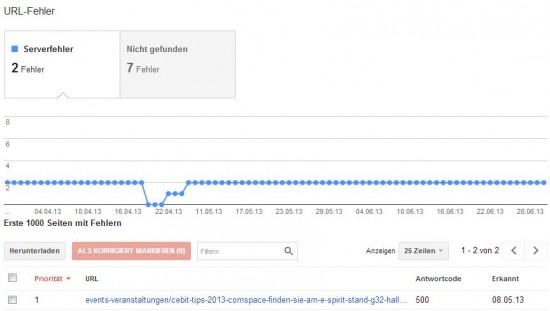

In der obigen Grafik wird beispielhaft dargestellt, wie dem Anwender über die Google Webmaster Tools mitgeteilt wird, dass eine URL der eigenen Website einen Antwortcode 500 liefert und dieses Problem am 08. Mai 2013 erkannt wurde.

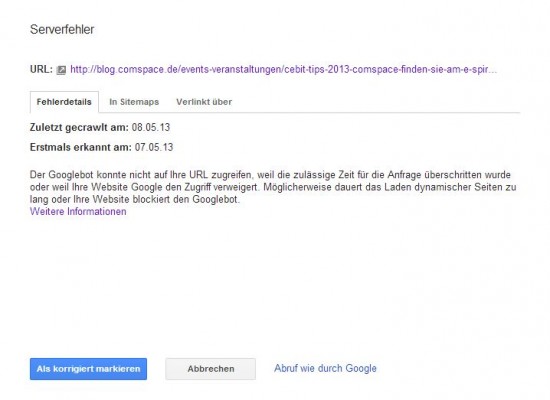

Um mehr Details zu der entsprechenden URL zu erfahren, reicht ein Klick auf diese URL, um das nachfolgende Popup zu öffnen.

Die Fehlerdetails sind eindeutig – der Googlebot hat bereits am 07.05.2013 versucht, besagte URL aufzurufen und konnte diese bzw. durfte diese URL möglicherweise nicht aufrufen. Eine weitere Überprüfung seitens der Suchmaschine Google erfolgte am 08.05.2013 – denn auch Google weiß, dass eine Website kurzfristig ausfallen kann und daher wird durch einen weiteren Versuch überprüft, ob das Problem weiterhin vorhanden ist.

Step 1: Warum geht die URL nicht

Im ersten Schritt gilt es für den Anwender zu überprüfen, warum diese URL für den Suchmaschinen-Bot nicht zu erreichen war bzw. warum genau diese Seite einen Antwortcode 500 liefert. Der Antwortcode 500 ist per Definition ein „Sammel-Statuscode“ für unerwartete Serverfehler.

Der comspace-Blog basiert auf WordPress. Anhand der URL ist zu erkennen, dass eine Vorschau-URL generiert wurde, die für den Google-Bot erreichbar war bzw. ist. Wenn die URL in einem aktuellen Browser abgerufen wird, so erhält der Anwender die Nachricht „Du hast nicht die erforderlichen Rechte, um die Entwurfsvorschau zu sehen.“ Im Fall von WordPress kann dies zwei Ursachen haben: Entweder ist der Link für die Entwurfsvorschau bereits abgelaufen oder eben der Anwender ist nicht angemeldet und kann dem entsprechend den Inhalt nicht lesen – aus Sicht des Anwenders eigentlich kein Problem. Das eigentliche Problem ist aber, dass hier eine URL der Suchmaschine zugänglich gemacht wurde, obwohl diese für die Suchmaschinen nicht bestimmt ist.

Step 2: Wie wurde die URL den Suchmaschinen zugänglich gemacht?

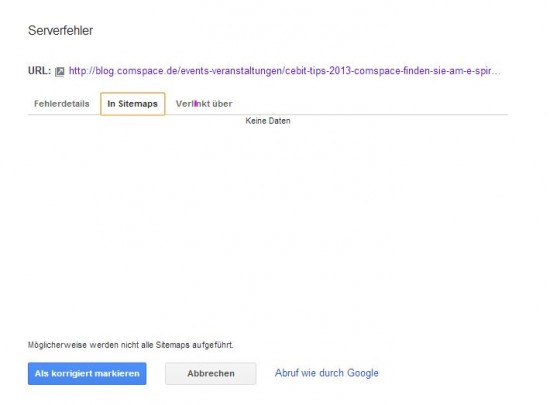

Dazu bieten die Google Webmaster Tools im gleichen Popup zwei Navigationspunkte namens „In Sitemaps“ und „Verlinkt über“. Im ersten Navigationspunkt kann überprüft werden, ob die Vorschau-URL beispielsweise in einer XML-Sitemap eingebunden ist und dem entsprechend von den Suchmaschinen wahrgenommen wird. Wie die nachfolgende Grafik beweist, ist diese URL zumindest nicht in der eingebunden XML-Sitemap enthalten.

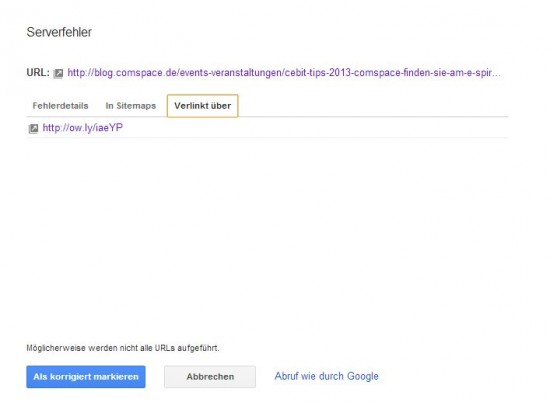

Der nächste Navigationspunkt erlaubt dem Anwender, die externen Verweise auf diese URL zu überprüfen und wie sich zeigt, wurde mittels Short-URL Dienst „ow.ly“ eine verkürzte URL zur einfachen Verbreitung der Vorschau erzeugt.

Bei der Überprüfung des externen Links erkennt man, dass dieser auf die obige Vorschau-URL weiterleitet. Es obliegt dem Anwender nun eine Lösung für dies Problem zu finden.

Lösungsansätze

Die Probleme sind grundsätzlich immer individuell und dem entsprechend gibt es keine pauschale Lösung, die sich auf jeden Serverfehler bzw. Antwortcode im Bereich 5xx übertragen lässt. Hinsichtlich der obigen Problematik gibt es einige Lösungsansätze, mit denen versucht werden kann, den seitens der Google Webmaster Tools angezeigten Serverfehler zu beheben.

URL weiterleiten

Sinnvollerweise sollte die URL auf den entsprechenden Artikel weitergeleitet werden – dazu kann eine Weiterleitungsregel (301 Redirect) in die htaccess eingebunden werden. Alternativ gibt es bei einigen Content Management Systemen eine Reihe von Plugins, die gerade für unerfahrene Nutzer in sehr einfacher Form die Möglichkeit bieten, bei Bedarf Weiterleitungen (301, 302, 307) zu erstellen.

Was tun, wenn kein Artikel existiert?

Häufig wird der Fehler gemacht, dass bei Artikeln, die nicht (mehr) existieren, die URL mittels einer Weiterleitung auf die Startseite umgeleitet werden. Dies sollte grundsätzlich vermieden werden, damit Suchmaschinen die Startseite nicht als allgemeine 404-Fehlerseite einstufen.

Im Idealfall wird eine URL auf einen neuen identischen Artikel weitergeleitet. Ist diese Möglichkeit nicht gegeben, empfiehlt es sich einen Redirect auf die nächst höhere Hierarchie-Ebene zu setzen.

Wenn aus irgendwelchen Gründen keine Weiterleitungen erstellt werden, ist es zwangsläufig notwendig, eine 404-Fehlerseite zu erstellen. Eine 404 Fehlerseite sollte grundsätzlich als Anleitung für den Nutzer dienen und ihm die Möglichkeit bieten, weiterhin mit einer Website zu arbeiten – dies kann durch Vorschläge geschehen („Meinten Sie vielleicht…?“). Auch bei einer 404 Fehlerseite gilt es den Nutzer abzuholen und ihn zu dem für ihn relevanten Inhalt zu geleiten.

URL sperren (Robots.txt)

Der Zugriff auf einzelne Dateien, Verzeichnisse sowie URLs kann für die Suchmaschinen-Bots (auch Robots) mithilfe einer „Robots.txt“ eingeschränkt werden. Bevor eine Website gecrawlt wird, überprüfen sogenannte Robots der jeweiligen Suchmaschinen, ob Einschränkungen für die Website bestehen. In der Regel übernehmen die meisten Suchmaschinen beim Crawl-Vorgang die Einschränkungen und besuchen die „gesperrten“ Inhalte nicht.

Zusätzlich kann in den Google Webmaster Tools unter „Google Index ->URLs entfernen“ die entsprechende URL eingetragen werden. Dadurch wird diese in der Regel schneller aus dem Index entfernt.

So einfach die Methode auch klingt, schützt diese nicht 100 % davor, dass die URL wieder in den Index aufgenommen wird. Sofern andere Websites auf die entsprechende URL verlinken, kann der Fall eintreten, dass diese zumindest teilweise in den Suchindex aufgenommen wird – dabei wird der Titel der Seite übernommen, allerdings die Meta-Description aufgrund der vorhandenen Robots.txt nicht.

Lösung – noindex

Es gibt eine funktionierende Lösung, sofern die Robots.txt genutzt wird und die Seite dauerhaft aus dem Index entfernt werden soll – das Zauberwort nennt sich Meta-Robots mit dem Wert „noindex“.

Einige CM-Systeme sind in der Lage, von Haus aus die Meta-Robots zu bearbeiten. Bei WordPress kann dies unter anderem durch den Einsatz eines Plugins gelöst werden – setzt aber dann auch voraus, dass die Seite tatsächlich existiert.

- Online Marketing Talk (OMTalk 2015) in Thyborøn, Dänemark - 13. Mai 2015

- Google bevorzugt „Mobile-freundliche Webseiten“ – neuer Rankingfaktor - 27. Februar 2015

- Google Webmaster Tools: Crawling Fehler im Blick haben - 15. April 2014

Hallo Herr Renk,

leider tauchen bei mir immer wieder diese Fehlermeldungen mit 500 als Antwortcode auf. Bereits mehrfach entfernte ich diese nicht mehr vorhandenen Seiten, aber anscheinend brachte dies alles nichts.

Kann es sein, dass das Problem beim Server und damit Hostinganbieter liegt?

Danke für Ihre Auskunft.

Viele Grüße

Michael Feigel