Wie unser „smarter“ Anrufbeantworter die Reaktionszeit um bis zu 90 % senkte

Hallo, ich bin Pascal, GenAI-Engineer und -Strategist bei comspace. Meine Leidenschaft für künstliche Intelligenz treibt mich täglich an – besonders, wenn wir mit KI-Lösungen Abläufe optimieren und so für unsere Kunden sowie das Unternehmen einen Mehrwert schaffen.

Wir bei comspace sind kontinuierlich auf der Suche nach innovativen Anwendungsfeldern für KI – insbesondere dort, wo sie Arbeitsprozesse effizienter gestaltet und sichtbare Fortschritte ermöglicht.

Aus diesem Spirit heraus entstand Mitte letzten Jahres die Idee und das interne Projekt, einen intelligenten, inhouse betriebenen Anrufbeantworter zu entwickeln, der unser Serviceniveau spürbar verbessert hat.

Warum eigentlich ein KI-Anrufbeantworter?

Die Situation ist vermutlich wohlbekannt: Das Telefon klingelt, aber niemand hat gerade Zeit, die Zentrale ist kurz nicht besetzt, alle sind im Meeting, in der Mittagspause oder in Kundengesprächen.

Was dann folgt, ist meist Standard: Der Anrufbeantworter geht ran, die Nachricht geht unter und die Reaktion verzögert sich – manchmal gehen so sogar Chancen verloren.

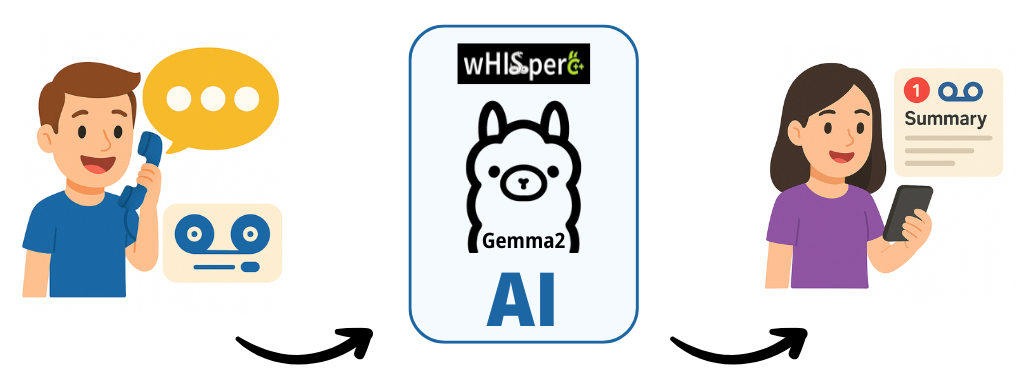

Das wollten wir ändern: Unser Ziel war eine KI, die Voicemails versteht, automatisch der passenden Ansprechperson zuordnet und dabei möglichst wenig manuellen Aufwand erfordert.

Von der Idee zum schnellen „Go“

In den vergangenen Monaten haben Open-Source-Sprachmodelle erhebliche Fortschritte in ihrer Leistungsfähigkeit gemacht. Gleichzeitig sind sie zunehmend kompakter und ressourcenschonender geworden, sodass ein DSGVO-konformer Inhouse-Betrieb mittlerweile gut realisierbar ist. Damit waren die technischen Voraussetzungen für unser Vorhaben erfüllt.

Nachdem ich die wichtigsten Herausforderungen identifiziert und den ersten Datenschutz-Check vorgenommen hatte, stellte ich die Idee bei der Geschäftsleitung vor – mit Erfolg! Die Zustimmung kam sofort, sodass die Umsetzung direkt starten konnte.

Open Source von Speech-to-Text bis Textanalyse

Für die Transkription der Sprachnachrichten fiel die Wahl auf das Speech-to-Text-Modell Whisper von OpenAI, genauer auf das Open-Source-Projekt „Whisper.cpp“, das auf Standard-Hardware sehr leistungsfähig läuft. Weder teure GPU-Server noch externe Cloud-Dienste waren notwendig.

Für die anschließende Analyse der Transkripte entschied ich mich für die kürzlich erschienene Modellfamilie Gemma2 von Google. Besonders das leistungsstarke Gemma2 27B Modell mit 27 Milliarden Parametern erwies sich als interessant, da es auch für deutschsprachige Texte sehr gute Ergebnisse liefert. Durch die Nutzung von Ollama, einer Open-Source-Plattform, mit der Sprachmodelle auf dem eigenen Server ausgeführt werden können, und der der dafür optimierten Gemma2-Modelle blieb der Hardwarebedarf moderat. Ein leistungsstarker Server mit viel RAM und guter CPU reichte völlig aus, extra Spezialhardware war nicht erforderlich.

Deutsch als KI-Herausforderung: lieber doppelt gemoppelt

Obwohl Whisper generell gute Ergebnisse liefert, bleibt Deutsch für KI-Modelle herausfordernd – insbesondere aufgrund von Akzenten, Dialekten, schwierigen Namen und undeutlicher Aussprache. Beim ausführlichen Test zeigte sich, dass die unterschiedlichen Whisper-Versionen variierende Stärken haben: Mal liefert Version 2, mal Version 3 bessere Resultate.

Deshalb nutze ich nun beide Versionen parallel. Das System erstellt zwei Transkriptionen und ein weiteres Sprachmodell (Gemma2 9B) entscheidet, welche Version aussagekräftiger ist – oder erstellt daraus eine optimierte Kombination.

Jede Transkription erhält außerdem eine Vertrauensbewertung. Ist diese zu niedrig, empfiehlt das System, die Originalaufnahme nachzuhören.

Übrigens: Whisper produziert gelegentlich kurios anmutende Transkriptelemente bei längeren Pausen oder Stille. So tauchen manchmal Textabschnitte auf wie „Musik Musik Musik“, „Klatschen Klatschen“, „Untertitel im Auftrag des ZDF, 2017“ oder „Vertraue und glaube, es hilft, es heilt die göttliche Kraft!“ – Trainingsdaten von ZDF und Co. lassen anscheinend grüßen!

Intelligente Analyse und automatisiertes Routing

Nach der zuverlässigen Transkription übernimmt das große Gemma2 27B-Modell die Analyse der Nachricht. Es liest das gesamte Transkript, filtert relevante Informationen heraus und beantwortet gezielt zentrale Fragen:

- Wer hat angerufen (Name, Firma, Kontext)?

- Wurden Kontaktinformationen genannt?

- Was ist das konkrete Anliegen?

- Welche Themen oder Anfragen wurden vorgebracht?

- Wurden bestimmte Mitarbeitende oder Ansprechpersonen genannt?

Die Analyse geht ins Detail: Erkannte Namen werden automatisch mit der internen Namensliste abgeglichen, sodass Nachrichten tatsächlich bei der richtigen Ansprechperson ankommen – zum Beispiel beim passenden Philipp? Filip? Phillipp? aus dem Marketing und nicht beim Namensvetter aus dem Vertrieb.

Spezielle Anliegen werden mit einer hinterlegten Zuständigkeitsmatrix abgeglichen (z. B. Jobs, Marketing, Vertrieb, Support). So landet jede Nachricht zuverlässig im richtigen Fachbereich.

Im nächsten Schritt erstellt die KI eine strukturierte Benachrichtigung: Sie fasst die Voicemail prägnant zusammen, extrahiert Kontaktinformationen und bewertet die Qualität der Transkription. Die Benachrichtigung wird direkt an die passenden Personen geschickt – der manuelle Aufwand sinkt deutlich, Informationsverluste werden vermieden und keine wichtige Anfrage bleibt lange unbeantwortet.

Livegang: IT, Datenschutz, Rollout

Nach Abschluss der Entwicklung übernahm Marco aus der IT und sorgte für eine reibungslose Installation und einen stabilen, performanten Betrieb im Rechenzentrum. Vielen Dank an dieser Stelle!

Im Anschluss an die finale DSGVO-Freigabe wurde das System freigeschaltet und wir waren gespannt auf die ersten echten Anwendungsfälle.

Schneller informiert, schneller reagiert

Schon die ersten Voicemails zeigten: Das System funktioniert zuverlässig und bringt echten Mehrwert. Zwischen Eingang der Voicemail und Benachrichtigung der zuständigen Person vergehen meist nur 1-2 Minuten. So konnte die Reaktionszeit teilweise um bis zu 90 % reduziert werden.

Fazit: KI als Service-Upgrade

Was nach technischem Gimmick klingt, ist bei comspace damit quasi ein echtes Service-Upgrade:

Anrufende erhalten schneller Feedback, unsere Mitarbeitenden werden ein wenig entlastet und der Datenschutz ist dabei gewährleistet.

Ein praxisnaher KI-Einsatz mit echtem Mehrwert – und für mich als GenAI-Engineer zudem eine persönlich Freude. Nebenbei gibt der KI-Anrufbeantworter dank gelegentlicher kleiner Transkriptionsfehler der KI, wie „Rauchmörder“ statt „Rauchmelder, auch immer mal wieder Anlass zur Erheiterung.

Insgesamt traten bei der Umsetzung nur wenige Hürden oder Schwierigkeiten auf. Voicemails, die das System komplett aus dem Tritt gebracht haben, lassen sich an einer Hand abzählen.

Die Ergebnisse der verschiedenen KI-Modelle waren ausreichend, um das Hauptziel der Lösung zu erreichen. Auch die Verarbeitungsperformance erwies sich angesichts der asynchronen Ausführung als völlig zufriedenstellend. Für eine Echtzeitkommunikation wäre sie auf der vorhandenen Hardware zwar nicht geeignet, dies war jedoch auch nicht Teil der Zielsetzung.

Mit den stetig neu erscheinenden Open-Source-Modellen werden sich Qualität und Performance künftig weiter verbessern. Die allgemeine Entwicklung in diesem Bereich ist ohnehin äußerst enorm und dynamisch.

PS: Solche KI-Pipelines lassen sich übrigens problemlos auf andere Szenarien anpassen. Falls ihr ähnliche Herausforderungen habt oder eine interne KI-Lösung sucht – sprecht mich/uns gern an!