Bereits im vergangenen Jahr keimten erste Hinweise auf ein weiteres Google Algorithmus Update auf. Denn zunächst wurde den Nutzern mithilfe eines zusätzlichen Snippet in den Google Suchergebnissen angezeigt, ob eine Webseite auch für mobile Endgeräte geeignet ist.

Dass Google durchaus ein Interesse daran hat, Internetseiten die für mobile Endgeräte ausgerichtet sind hervorzuheben, zeigte sich bereits im November des vergangenen Jahres, als Google entsprechende Suchergebnisse in den Google SERPS mit dem Zusatz „Für Mobilegeräte“ gekennzeichnet hat.

Google legt nach eigenen Angaben großen Wert auf die Benutzerfreundlichkeit und spricht immer wieder von einem perfekten Nutzererlebnis beim Besuch von Internetseiten. Als zusätzlicher Gradmesser zu den vielen Faktoren, die Google für das Ranking von Internetseiten heranzieht, könnte in Zukunft auch „mobile-friendly“ gehören. Webseiten, die diesen Vorgaben der Google Richtlinien nicht entsprechen, müssen mit schlechteren Ranking-Ergebnissen rechnen.

Die grundsätzliche Idee dahinter ist allerdings nicht neu, denn schon seit geraumer Zeit bezieht Google nutzerbezogene Informationen, darunter z.B. auch Interessen, Geo-Daten, Alter und Geschlecht, in die Ausgabe der Suchergebnisse mit ein. Auch die gewonnen Informationen aus einem Webseitenbesuch, sprich die Absprungrate, die Aktivitäten und die Verweildauer, sind Faktoren zur Bestimmung von Ranking-Positionen.

Google verschickt Warnhinweise über die Webmaster Tools

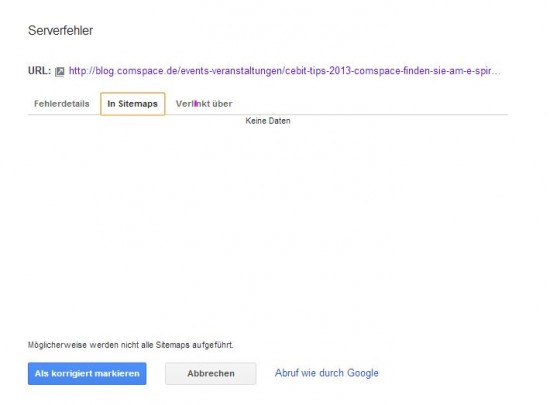

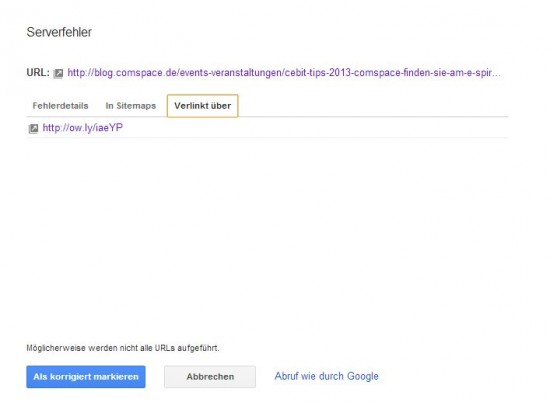

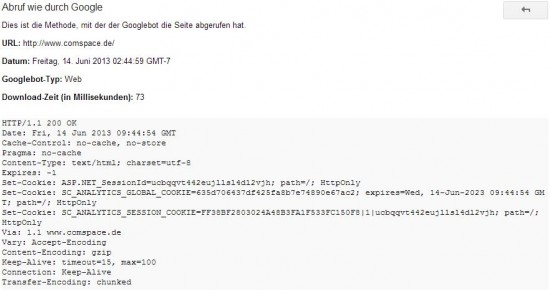

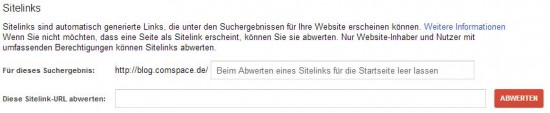

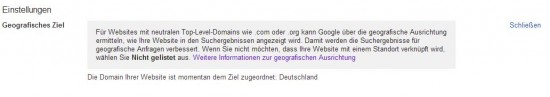

Ein Grund, warum jede Webseite in den Google Webmaster Tools eingetragen werden sollte ist, dass Google mit dem Inhaber einer Webseite über diesen Kanal kommuniziert. Mithilfe der Nachrichtenzentrale der Google Webmaster Tools teilt Google den Webseitenbetreiber mit, ob es Probleme, Hinweise und Empfehlungen für die eigene Webseite gibt.

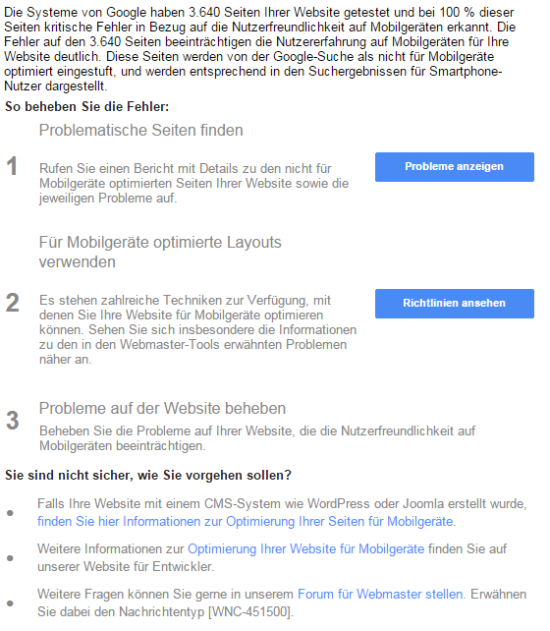

In Bezug auf das aktuelle Thema verschickt Google an die Webseitenbetreiber Mitteilungen mit dem Betreff “Beheben Sie Probleme der mobilen Nutzerfreundlichkeit auf Domain.de” an den Webmaster der Webseite.

Weiter heißt es in der Mitteilung: “Die Systeme von Google haben 1 Seiten Ihrer Website getestet und bei 100 % dieser Seiten kritische Fehler in Bezug auf die Nutzerfreundlichkeit auf Mobilgeräten erkannt. Die Fehler auf den 1 Seiten beeinträchtigen die Nutzererfahrung auf Mobilgeräten für Ihre Website deutlich. Diese Seiten werden von der Google-Suche als nicht für Mobilgeräte optimiert eingestuft, und werden entsprechend in den Suchergebnissen für Smartphone-Nutzer dargestellt.”

Kurzum – die betroffene Webseite entspricht nicht den Vorgaben der Google Webmasterrichtlinien für mobile Webseiten und es bedarf einer Anpassung. Webseitenbetreiber sind demnach gezwungen, zu evaluieren ob es Möglichkeiten gibt, die betroffene Webseite zeitnah auf ein Google konformes Layout umzustellen.

Ich habe keine Mitteilung erhalten, bin ich auf der sicheren Seite?

Aktuell werden die Nachrichten nicht geschlossen an die Betreiber verschickt, sondern nach und nach, sodass noch eine entsprechende Nachricht eintreffen könnte, auch wenn jetzt noch nicht jeder Anwender eine Benachrichtigung in seinem Postkasten vorgefunden hat.

Ist meine Webseite mobilefähig?

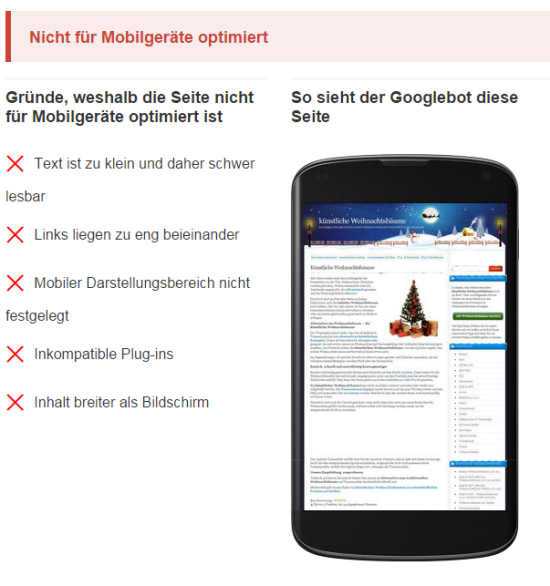

Wer bisher noch keine Nachricht erhalten hat, kann im Vorfeld mithilfe der von Google bereitgestellten Oberfläche überprüfen, ob seine Webseite für mobile Endgeräte geeignet ist.

Das entsprechende Test-Tool befindet sich unter der Url:

- https://www.google.com/webmasters/tools/mobile-friendly/

Die Anwendung des Tools ist relativ simpel: Die URL wird in das entsprechende Feld eingetragen und nach einem Klick auf “Analysieren” untersucht der Crawler die Website.

Leider macht Google keine besonders detaillierten Angaben, wenn es um die möglichen Optimierungspotentiale geht, daher empfiehlt es sich, noch ein weiteres Tool von Google in Anspruch zu nehmen und zwar Google Pagespeed.

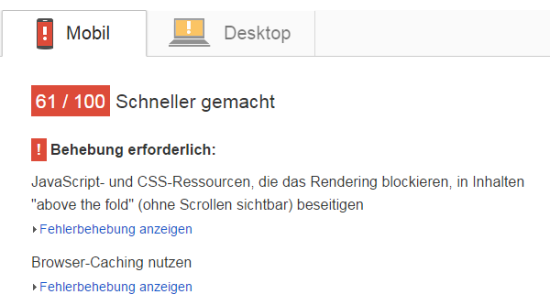

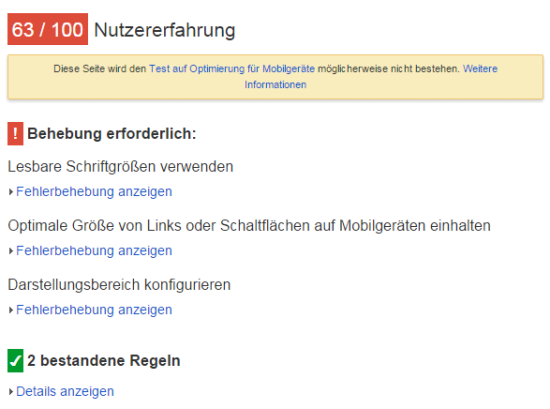

Google Pagespeed überprüfen

Hier kann der Anwender nun auch einsehen, welche Probleme und auch Hinweise Google für den Anwender parat hält. Die Analyse unterteilt Google in die Tabs “Mobil” und “Desktop” sowie jeweils in “Schneller gemacht” und “Nutzererfahrung”. In Bezug auf das Thema ist der Punkt Nutzererfahrung relevant, allerdings sei an dieser Stelle angemerkt, dass die Ladegeschwindigkeit einer Website auch einen Einfluss auf das Ranking haben kann.

Rankingfaktor – Mehr mobilfreundliche Websites in Suchergebnissen

Ab dem 21. April gilt die Optimierung für Mobilgeräte auch als Rankingsignal. Die angekündigte Änderung wirkt sich auf mobile Suchanfragen in allen Sprachen weltweit aus. In Zukunft werden Internetnutzer bei Suchanfragen Ergebnisse erhalten, die sowohl relevant in Bezug auf die Anfrage als auch hinsichtlich dem verwendeten Gerät sind.